Die xG-Metrik: Expected Goals in der modernen Fußballanalyse

Fußball galt lange als Sport, der sich statistischer Analyse entzieht. Zu viele Variablen, zu wenig Tore, zu viel Zufall. Dann kam Expected Goals — und veränderte die Diskussion grundlegend. xG misst nicht, was passiert ist, sondern was hätte passieren sollen. Und dieser Perspektivwechsel hat die Art revolutioniert, wie Trainer, Analysten und Fans über Fußball denken.

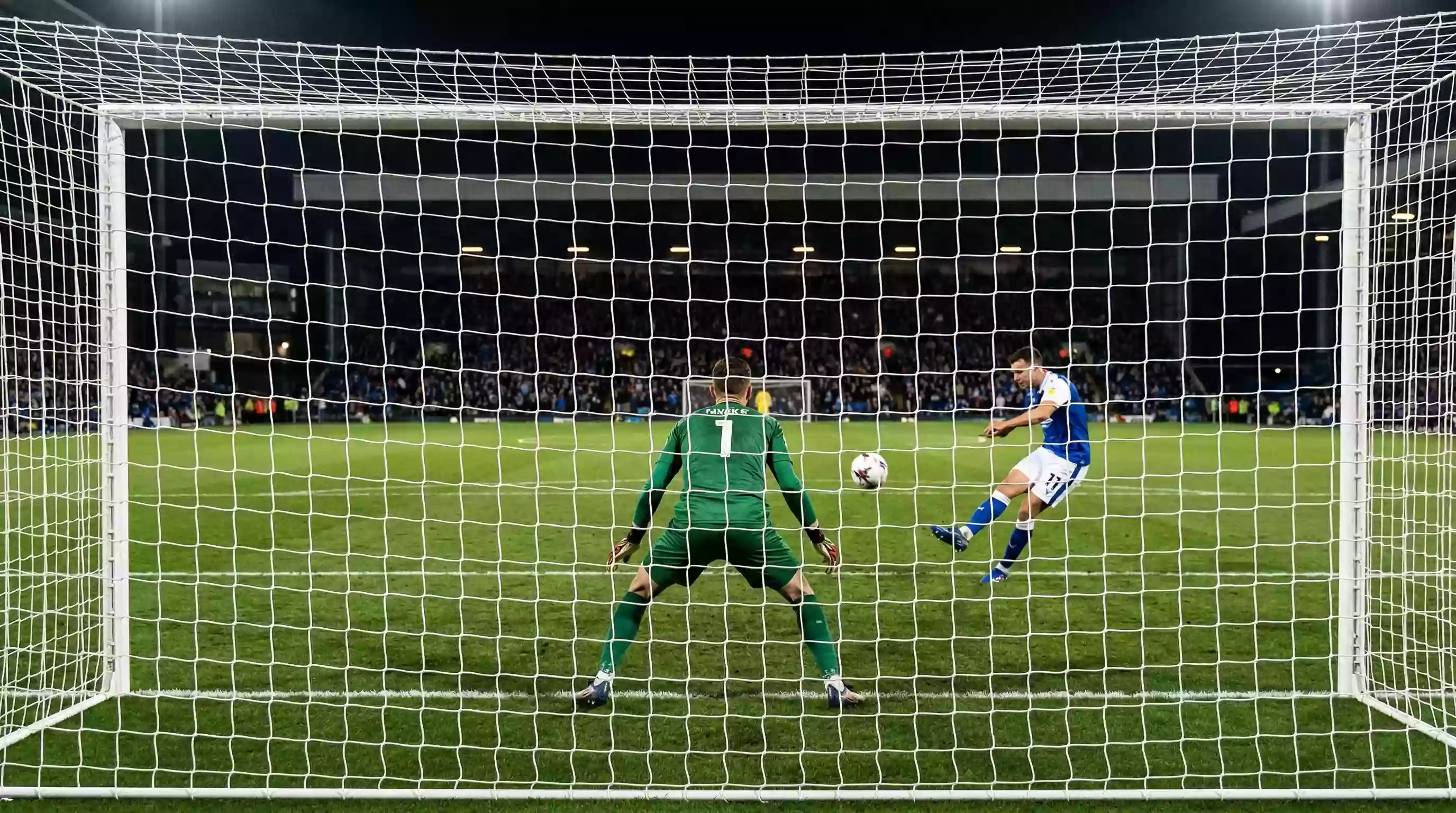

Die Idee ist bestechend einfach: Jeder Torschuss hat eine bestimmte Wahrscheinlichkeit, im Tor zu landen. Ein Elfmeter liegt bei etwa 76 Prozent, ein Kopfball aus 15 Metern vielleicht bei 3 Prozent. Addiert man alle Schusswahrscheinlichkeiten einer Mannschaft, erhält man deren Expected Goals — die erwartete Torzahl basierend auf der Qualität ihrer Chancen.

Warum ist das wichtig? Weil das Endergebnis lügen kann. Ein Team, das 0:1 verliert, aber 2,5 xG erzielt hat, war vermutlich die bessere Mannschaft. Der Gegner hatte Glück, der eigene Stürmer einen schlechten Tag. Über eine Saison gleichen sich solche Schwankungen aus, aber in einzelnen Spielen dominiert oft der Zufall. xG hilft, Substanz von Glück zu trennen.

Die Ursprünge der Metrik reichen in die frühen 2010er Jahre zurück, als Analysten wie Sam Green und Michael Caley begannen, Schussqualität systematisch zu quantifizieren. Der Durchbruch kam mit der Popularisierung durch Opta und später StatsBomb, die xG-Daten für Medien und Vereine zugänglich machten. Heute ist xG aus der professionellen Fußballanalyse nicht mehr wegzudenken.

Bundesliga-Vereine wie Bayern München, Borussia Dortmund und RB Leipzig beschäftigen Analyseteams, für die xG zum Standardwerkzeug gehört. Auch Wettanbieter nutzen die Metrik zur Quotenkalkulation. Wer moderne Fußballanalyse verstehen will, kommt an Expected Goals nicht vorbei.

Die Metrik hat mittlerweile den Mainstream erreicht. Sky, DAZN und andere Sender blenden xG-Werte ein, Fußball-Manager diskutieren in Podcasts über „xG-Überperformance“, und selbst Stammtischgespräche drehen sich manchmal um die Frage, ob der Sieg „verdient“ war. Diese Popularität birgt allerdings Risiken: xG wird oft missverstanden, überinterpretiert oder als Allheilmittel verkauft.

In den folgenden Abschnitten erklären wir, wie xG berechnet wird, woher die Daten kommen und warum verschiedene Anbieter unterschiedliche Werte liefern. Wir zeigen, wie Sie xG für Prognosen nutzen können, und benennen die Grenzen der Metrik. Denn xG ist ein Werkzeug — nicht die Wahrheit über Fußball. Qualität statt Quantität der Chancen erfassen: Das kann xG. Den Fußball vollständig erklären: Das kann niemand.

Durch den Vergleich von xG-Werten mit den Buchmacherquoten lässt sich profitables Value Betting im Fußball betreiben.

xG-Metrik: Kalibrierung von Torwahrscheinlichkeiten

Expected Goals basiert auf einer simplen Frage: Wie oft führt ein Schuss aus dieser Position, unter diesen Umständen, zum Tor? Die Antwort kommt aus der Analyse tausender historischer Schüsse. Machine-Learning-Modelle lernen aus diesen Daten, welche Faktoren die Torwahrscheinlichkeit beeinflussen — und wie stark.

Die wichtigsten Einflussfaktoren

Der mit Abstand wichtigste Faktor ist die Distanz zum Tor. Je näher der Schütze, desto höher die Trefferwahrscheinlichkeit. Das klingt trivial, aber die Präzisierung ist es nicht. Eine Analyse von Anzer und Bauer mittels SHAP-Methoden zeigt, dass die Entfernung zum Tor der einflussreichste Prädiktor in modernen xG-Modellen ist. Andere Faktoren folgen, aber keiner erreicht dieselbe Bedeutung.

Der Winkel zum Tor ist der zweite zentrale Faktor. Ein Schuss aus der Mitte bietet mehr Torfläche als einer aus spitzem Winkel. Deshalb haben Schüsse vom Elfmeterpunkt (zentral, 11 Meter) höhere xG-Werte als solche vom Strafraumeck (seitlich, ähnliche Distanz).

Weitere Variablen umfassen: Körperteil (Fuß vs. Kopf), Spielsituation (offenes Spiel vs. Freistoß vs. Elfmeter), Anzahl der Verteidiger zwischen Ball und Tor, Position des Torwarts, vorherige Aktion (Flanke, Dribbling, Pass). Fortgeschrittene Modelle berücksichtigen dutzende solcher Features.

Wie das Modell lernt

Die Modelle werden auf historischen Daten trainiert. Man nimmt zehntausende Schüsse mit bekanntem Ausgang (Tor oder kein Tor), extrahiert für jeden Schuss die relevanten Features und trainiert einen Algorithmus, die Torwahrscheinlichkeit vorherzusagen. Die Qualität des Modells hängt von der Datenmenge, der Feature-Auswahl und dem Algorithmus ab.

Der Trainingsvorgang optimiert die Gewichtung der Features. Das Modell lernt etwa, dass Distanz wichtiger ist als Winkel, und Winkel wichtiger als Körperteil. Diese Gewichtungen sind nicht willkürlich, sondern emergieren aus den Daten. Die besten Modelle erreichen Kalibrierung: Schüsse mit xG 0,3 führen tatsächlich in etwa 30 Prozent der Fälle zum Tor.

David Sumpter, Mathematikprofessor und Autor von „Soccermatics“, beschreibt die Bedeutung dieser Entwicklung so: „This xG way of thinking has changed the way fans view football. Forever.“ — David Sumpter, Professor für angewandte Mathematik, Uppsala University. Die Metrik hat nicht nur die Analyse verändert, sondern auch die Wahrnehmung. Fans fragen nicht mehr nur „Wer hat gewonnen?“, sondern „Wer hatte die besseren Chancen?“.

Von Schuss zu Spiel

Ein einzelner Schuss hat einen xG-Wert zwischen 0 und 1. Ein Elfmeter liegt typischerweise bei 0,76, ein Weitschuss aus 25 Metern bei 0,03. Die Summe aller Schüsse einer Mannschaft ergibt deren Match-xG. Wenn Bayern in einem Spiel zehn Schüsse mit einem Gesamt-xG von 2,3 abgibt, „erwarten“ wir statistisch 2,3 Tore — unabhängig davon, wie viele tatsächlich fielen.

Die Abweichung zwischen xG und tatsächlichen Toren über mehrere Spiele hinweg zeigt die „Chancenverwertung“ einer Mannschaft oder eines Spielers. Wer konstant mehr Tore als xG erzielt, verwertet entweder überdurchschnittlich gut — oder hatte Glück. Über eine ganze Saison tendiert die Differenz gegen null, aber in kürzeren Zeiträumen sind erhebliche Abweichungen normal.

xG pro Schuss vs. Gesamtbild

Ein häufiger Fehler ist die Fokussierung auf Einzelwerte. Ein xG von 0,4 für einen bestimmten Schuss sagt wenig aus. Interessant wird es im Aggregat: Erzielt eine Mannschaft regelmäßig hohe xG-Werte, hat sie ein funktionierendes Offensivspiel. Kassiert sie regelmäßig hohe xG gegen sich, hat die Defensive Probleme.

Für Prognosen ist das entscheidend. Nicht das letzte Spielergebnis zählt, sondern der xG-Verlauf über fünf, zehn, fünfzehn Spiele. Teams, die über längere Zeit mehr xG erzeugen als zulassen, werden tendenziell Punkte sammeln — auch wenn einzelne Spiele gegen sie laufen.

Expected Assists und erweiterte Metriken

Neben xG existieren verwandte Metriken. Expected Assists (xA) misst die Qualität von Pässen, die zu Schüssen führen. Ein Steilpass in den Strafraum hat höheren xA als eine Flanke von der Seitenlinie. Die Kombination aus xG und xA ergibt ein vollständigeres Bild der Offensivleistung.

Weitere Erweiterungen umfassen xGChain (alle Aktionen, die zu einem Schuss führen), xGBuildup (ohne die finale Aktion) und Non-Penalty xG (xG ohne Elfmeter). Jede Metrik beantwortet eine andere Frage. Für Prognosen ist Non-Penalty xG oft nützlicher, weil Elfmeter stark von Zufallsfaktoren abhängen.

Datenquellen und Modellunterschiede

Nicht alle xG-Werte sind gleich. Wenn Sky einen xG von 1,8 für Bayern anzeigt und Understat 2,1, liegt das nicht an einem Fehler. Verschiedene Anbieter verwenden unterschiedliche Modelle, Datenquellen und Methoden. Das Verständnis dieser Unterschiede ist essenziell, um xG richtig zu interpretieren.

Die großen Datenanbieter

Opta (Teil von Stats Perform) ist der älteste und verbreitetste Anbieter. Ihre Daten speisen die meisten TV-Übertragungen und Medienberichte. Opta beschäftigt hunderte Analysten, die jedes Spiel der großen Ligen manuell taggen. Die Datentiefe ist enorm, aber die xG-Methodik ist proprietär und nicht vollständig dokumentiert.

StatsBomb hat sich als Premium-Alternative etabliert. Das Unternehmen bietet detailliertere Event-Daten, inklusive Freeze-Frames, die Spielerpositionen zum Zeitpunkt des Schusses erfassen. Das ermöglicht präzisere xG-Modelle, aber die Daten sind kostenpflichtig und für Privatpersonen kaum zugänglich.

FBref aggregiert Daten verschiedener Quellen und bietet sie kostenlos an. Für die großen europäischen Ligen stammen die xG-Werte von StatsBomb. FBref ist damit die beste frei zugängliche Quelle für xG-Daten — mit dem Vorbehalt, dass nicht alle Ligen abgedeckt sind.

Understat berechnet eigene xG-Werte auf Basis öffentlich verfügbarer Informationen. Die Methodik ist dokumentiert, die Werte weichen aber von Opta und StatsBomb ab. Für Hobbyanalysten ist Understat wegen der Transparenz attraktiv.

Warum die Werte abweichen

Die Unterschiede haben mehrere Ursachen. Erstens: Feature-Auswahl. Manche Modelle berücksichtigen die Position des Torwarts, andere nicht. Manche integrieren die Körperhaltung des Schützen, andere ignorieren sie. Mehr Features bedeuten nicht automatisch bessere Vorhersagen — manchmal führen sie zu Overfitting.

Zweitens: Trainingsdaten. Ein Modell, das auf Premier-League-Daten trainiert wurde, performt möglicherweise anders in der Bundesliga. Spielstile, Defensivverhalten und Torwartqualität unterscheiden sich zwischen Ligen. Universelle Modelle mitteln diese Unterschiede weg.

Drittens: Algorithmen. Eine Studie der ESPJETA zeigt, dass XGBoost-basierte xG-Modelle etwa 80 Prozent Genauigkeit bei der Klassifikation von Sieger und Verlierer erreichen. Aber verschiedene Algorithmen — Random Forest, Gradient Boosting, neuronale Netze — liefern leicht unterschiedliche Ergebnisse.

Was bedeutet das für die Nutzung?

Die praktische Konsequenz: Vergleichen Sie xG-Werte nur innerhalb derselben Quelle. Ein FBref-xG von 2,0 ist nicht direkt mit einem Understat-xG von 2,0 vergleichbar. Für Trendanalysen über Zeit oder Ligavergleiche sollten Sie bei einem Anbieter bleiben.

Für Prognosen ist die absolute Höhe des xG weniger wichtig als die Differenz. Wenn Team A konstant 0,5 xG mehr erzeugt als zulässt (unabhängig vom Anbieter), hat es vermutlich einen Qualitätsvorteil. Die Relationen sind stabil, auch wenn die absoluten Zahlen schwanken.

Historische Entwicklung der Modelle

Die ersten xG-Modelle waren simpel: Distanz und Winkel zum Tor, sonst nichts. Mit zunehmender Datenverfügbarkeit wuchsen die Modelle. Heute integrieren fortgeschrittene Ansätze Dutzende Variablen, von der Verteidiger-Position bis zur Spielminute. Die Genauigkeit ist gestiegen, aber nicht linear — irgendwann setzt Overfitting ein.

Die nächste Generation dürfte Tracking-Daten nutzen: GPS-Positionen aller Spieler, Ballgeschwindigkeit, Laufwege. Erste Vereine experimentieren bereits damit. Für die breite Öffentlichkeit bleiben diese Daten aber vorerst unzugänglich.

Die Grenzen der Datenqualität

Selbst die besten Anbieter haben blinde Flecken. Nicht jedes Spiel wird mit derselben Intensität getrackt. Manche Ligen haben weniger Datenabdeckung, manche Wettbewerbe werden gar nicht erfasst. Und die manuelle Codierung — „War das ein Schuss oder eine Flanke?“ — birgt Subjektivität.

Für die großen fünf Ligen (England, Spanien, Deutschland, Italien, Frankreich) ist die Datenlage exzellent. Für kleinere Ligen, Pokalwettbewerbe oder Jugendligen müssen Sie mit Einschränkungen rechnen. xG ist ein Werkzeug für den Mainstream-Fußball, nicht für jede Nische.

xG für Prognosen nutzen

xG ist keine Prognose, sondern ein Input für Prognosen. Die Metrik beschreibt Vergangenheit — was ein Team in bisherigen Spielen an Chancen kreiert und zugelassen hat. Daraus lassen sich Erwartungen für zukünftige Spiele ableiten, aber der Schritt erfordert Methodik.

xG-Differenz als Qualitätsmaß

Der einfachste Ansatz: Berechnen Sie die xG-Differenz pro Spiel für jedes Team über die letzten zehn Spiele. Ein Team mit +0,8 xG-Differenz erzeugt im Schnitt 0,8 Expected Goals mehr als es zulässt. Das ist ein solider Indikator für Qualität — und ein besserer Prädiktor für zukünftige Ergebnisse als die tatsächliche Tordifferenz.

Warum? Weil die tatsächliche Tordifferenz Zufall enthält. Ein Team kann 3:0 gewinnen, obwohl beide Mannschaften jeweils 1,2 xG hatten. Das Ergebnis war dann nicht repräsentativ für das Spielniveau. Die xG-Differenz filtert solchen Zufall heraus.

Von xG zu Wahrscheinlichkeiten

Für konkrete Prognosen müssen xG-Werte in Wahrscheinlichkeiten umgerechnet werden. Der übliche Weg führt über Poisson-Verteilung: Man nimmt die erwarteten Tore für jedes Team und simuliert Spielausgänge. Wenn Team A einen xG von 1,5 hat und Team B von 1,0, ergeben sich daraus Verteilungen möglicher Ergebnisse.

Die Poisson-Verteilung modelliert, wie wahrscheinlich 0, 1, 2, 3 oder mehr Tore sind, gegeben einen Erwartungswert. Mit zwei Poisson-Verteilungen (eine pro Team) lassen sich alle möglichen Ergebniskombinationen und deren Wahrscheinlichkeiten berechnen. Die Summe der Wahrscheinlichkeiten für Heimsieg, Unentschieden und Auswärtssieg ergibt Ihre Spielprognose.

Eine Analyse der Prager Karls-Universität zeigt, dass xG-basierte Modelle profitabel werden können, wenn Sie selektiv vorgehen. Bei Spielen, in denen das Modell mehr als 70 Prozent Siegwahrscheinlichkeit anzeigt, übersteigt der erwartete Gewinn die Buchmacher-Marge. Unterhalb dieser Schwelle frisst die Marge den theoretischen Vorteil auf.

Beispiel: Matchday-Analyse

Nehmen wir an, Leverkusen empfängt Stuttgart. In den letzten zehn Spielen hatte Leverkusen eine xG-Differenz von +1,2, Stuttgart von +0,3. Das spricht für Leverkusen. Aber was sagen die Quoten? Wenn Leverkusen bei 1,60 steht, impliziert das etwa 62 Prozent Siegwahrscheinlichkeit.

Jetzt bauen Sie Ihr Modell: Auf Basis der xG-Differenzen, Heimvorteil und direkten Vergleichen schätzen Sie Leverkusens Siegwahrscheinlichkeit auf 68 Prozent. Die Differenz von 6 Prozentpunkten ist Ihr potenzieller Edge. Ob das Value ist, hängt von der Robustheit Ihrer Schätzung ab.

xG in Kombination mit anderen Metriken

xG allein erzählt nicht die ganze Geschichte. Wie entstehen die Chancen? Dominierende Ballbesitzteams haben andere xG-Profile als konternde Mannschaften. Ein Team mit vielen Weitschüssen produziert niedrige xG pro Schuss, aber möglicherweise hohes Gesamtvolumen. Ein Team mit wenigen, aber hochkarätigen Chancen hat die umgekehrte Signatur.

Für Prognosen lohnt es sich, xG mit Ballbesitz, Passgenauigkeit und Pressingintensität zu kombinieren. Solche Multivariablen-Modelle sind komplexer, aber robuster gegen Einzelspiel-Ausreißer.

Saisonale Muster erkennen

xG-Daten offenbaren Muster, die im Ergebnis unsichtbar bleiben. Ein Team, das zu Saisonbeginn Punkte verliert, aber hohe xG produziert, wird vermutlich aufholen. Umgekehrt: Ein Team, das trotz niedriger xG gewinnt, lebt auf Pump. Solche Diskrepanzen sind Value-Signale für Wetter, die gegen die öffentliche Wahrnehmung setzen wollen.

Die Regression zum Mittelwert ist dabei der statistische Hebel. Extreme Abweichungen zwischen xG und Toren normalisieren sich über Zeit. Wer früh in der Saison solche Anomalien erkennt, kann profitieren, bevor der Markt reagiert.

Werkzeuge für die xG-Analyse

Kostenlose Ressourcen wie FBref, Understat und Fotmob bieten xG-Daten für die großen Ligen. Excel-Tabellen oder Python-Skripte ermöglichen eigene Auswertungen. Wer tiefer einsteigen will, findet bei StatsBomb kostenlose Datensätze für ausgewählte Wettbewerbe — ideal zum Experimentieren mit Modellen.

Grenzen von xG: Was die Metrik nicht erfasst

xG ist populär geworden, vielleicht zu populär. Die Metrik wird manchmal als objektive Wahrheit behandelt, obwohl sie nur ein Modell ist. Modelle haben Grenzen. Wer xG klug nutzen will, muss diese Grenzen kennen.

Die Spielerqualität fehlt

Ein xG von 0,3 bedeutet: Der durchschnittliche Spieler trifft aus dieser Position in 30 Prozent der Fälle. Aber was, wenn der Schütze Haaland ist? Oder ein müder Ersatzspieler in der 89. Minute? Das Standard-xG-Modell unterscheidet nicht. Es behandelt jeden Schützen gleich.

Einige Anbieter berechnen deshalb „xGOT“ — Expected Goals on Target, das die Platzierung des Schusses berücksichtigt. Oder Post-Shot-xG, das nach dem Schuss die Qualität bewertet. Aber selbst diese Erweiterungen erfassen nicht die individuelle Klasse eines Spielers vor dem Schuss.

Kontext geht verloren

xG sagt nichts über den Spielverlauf. Eine Mannschaft, die 2,0 xG in den ersten 15 Minuten erzeugt und dann nur noch verteidigt, hat ein anderes Profil als eine, die konstant 0,2 xG pro 10 Minuten produziert. Für Prognosen ist der Kontext relevant: Führt ein Team, kontert es? Ist es taktisch flexibel?

Auch Spielsituationen werden unvollständig erfasst. Ein Schuss nach einem Konter gegen eine aufgerückte Abwehr hat andere Dynamik als einer nach 30 Pässen gegen einen tief stehenden Block. Das xG-Modell sieht nur die finale Position, nicht den Weg dorthin.

Systematische Verzerrungen

Modelle sind nur so gut wie ihre Trainingsdaten. Wenn ein Modell hauptsächlich auf Premier-League-Spielen trainiert wurde, kann es Bundesliga-Spiele systematisch falsch bewerten. Spielstile unterscheiden sich: Mehr Pressing, höhere Intensität, andere Torwartqualitäten. Diese Unterschiede gehen in universelle Modelle nicht ein.

Zudem: xG-Modelle basieren auf der Vergangenheit. Wenn sich der Fußball ändert — neue Taktiken, andere Regelauslegungen, VAR-Einführung —, brauchen die Modelle Zeit zur Anpassung. In Übergangsphasen sind die Vorhersagen weniger zuverlässig.

Die Genauigkeitsfrage

Wie gut sind xG-basierte Prognosen wirklich? Die Antwort hängt vom Zeithorizont ab. Für einzelne Spiele ist die Genauigkeit begrenzt. Poisson-Modelle auf Basis von xG erreichen etwa 50 Prozent Genauigkeit bei der Vorhersage des exakten Ergebnisses — kaum besser als einfachere Methoden.

Für langfristige Analysen sieht es besser aus. xG-Differenz über eine Saison korreliert stark mit der Endplatzierung. Teams, die konstant mehr xG erzeugen als zulassen, landen oben. Aber diese Erkenntnis hilft wenig für die Prognose einzelner Spieltage.

Die Implikation für Wetter: xG ist nützlicher zur Identifikation von Value als zur Vorhersage einzelner Ergebnisse. Ein Team, das vom Markt unterschätzt wird (niedrige Quoten trotz starker xG-Bilanz), bietet potenziellen Value. Die Prognose selbst bleibt unsicher, aber das Verhältnis von Chance zu Quote stimmt.

Sumpters Warnung

David Sumpter, der die xG-Revolution mitgeprägt hat, mahnt zur Vorsicht. In seinen Analysen zur Aussagekraft von xG schreibt er: „After 16 matches, the difference between the noise in xG and the noise in real goals is only 0.1 goal per match. (…) Expected goals are a mathematical model. Models aren’t reality. Goals are reality.“ Die Botschaft ist klar: xG ist ein Werkzeug, keine Offenbarung.

Die Gefahr liegt in der Überinterpretation. Wer jede xG-Differenz von 0,2 für bedeutsam hält, überfordert die Metrik. Erst über viele Spiele verdichtet sich das Rauschen zur Substanz. Für Einzelspielprognosen bleibt erhebliche Unsicherheit — und das ist keine Schwäche von xG, sondern die Natur des Fußballs.

Das Problem der Stichprobengröße

Fußball produziert weniger Datenpunkte als andere Sportarten. Ein Team schießt vielleicht 15 Mal pro Spiel, davon sind 5 ernstzunehmende Chancen. Über zehn Spiele sind das 50 relevante Schüsse — statistisch gesehen wenig. Die daraus abgeleiteten xG-Werte haben erhebliche Unsicherheit.

Für Prognosen bedeutet das: Vertrauen Sie xG-Trends erst nach mindestens 10 bis 15 Spielen. Früher in der Saison sind die Daten zu volatil. Ein Team, das nach fünf Spielen +1,5 xG-Differenz hat, könnte nach zehn Spielen bei +0,3 liegen. Die frühen Werte waren Rauschen, nicht Signal.

Fehlende Variablen

xG erfasst nicht, was vor dem Schuss passiert. Wie ist die Chance entstanden? War es ein Konter gegen eine aufgerückte Abwehr? Ein langer Ball gegen Pressing? Ein geniales Dribbling? Diese Kontexte beeinflussen die tatsächliche Torwahrscheinlichkeit, gehen aber nicht in das Standard-xG-Modell ein.

Auch psychologische Faktoren fehlen: Spielminute, Spielstand, Drucksituation. Ein Schuss in der 90. Minute bei 0:1 Rückstand hat andere Dynamik als derselbe Schuss beim Stand von 3:0. Das Modell sieht nur die Position, nicht den Moment.

Expected Goals hat die Fußballanalyse bereichert. Die Metrik bietet einen objektiveren Blick auf Spielqualität als das bloße Ergebnis und hilft, Substanz von Zufall zu trennen. Aber xG ist kein Ersatz für andere Analysemethoden — es ist eine Ergänzung.

Der richtige Umgang mit xG erfordert Bescheidenheit. Die Metrik ist ein Modell, nicht die Realität. Sie erfasst Schussqualität, aber nicht Spielerklasse. Sie aggregiert Vergangenheit, aber garantiert nicht die Zukunft. Wer diese Grenzen akzeptiert, gewinnt ein mächtiges Analysewerkzeug. Wer xG überstrapaziert, produziert Schein-Präzision.

Für präzisere Prognosen sollten Sie xG mit anderen Ansätzen kombinieren. ELO-Ratings erfassen die historische Teamstärke, Machine-Learning-Modelle integrieren dutzende Variablen, und Bankroll-Management sorgt dafür, dass selbst Fehlprognosen Sie nicht ruinieren. Qualität statt Quantität der Chancen — dieses Prinzip gilt nicht nur für Fußballer, sondern auch für Analysten. Wenige, aber fundierte Prognosen schlagen hektisches Wetten auf jeden Spieltag.

Unser Expertenteam erstellt täglich fundierte mathematische Fußball Vorhersagen für alle Top-Ligen.